Według raportu Światowej Organizacji Zdrowia ponad 2,2 mld osób jest niewidomych lub niedowidzących. Liczba ta rośnie ze względu na takie czynniki, jak wydłużający się czas, który spędzamy w zamkniętych pomieszczeniach, przed ekranami komputerów i smartfonów, co może prowadzić do krótkowzroczności. Wzrasta również liczba przypadków cukrzycy, a jednym z potencjalnych skutków tej choroby są zaburzenia widzenia.

Wiele osób z upośledzeniem wzroku nie jest w stanie zapewnić sobie niezbędnej opieki, doświadcza wyzwań związanych z bezpieczną nawigacją i pragnie większej niezależności. Obecnie technologia pomaga im widzieć otaczający świat w sposób wykraczający poza postrzeganie wzrokowe.

Tekst opisowy dla map mentalnych

To, jak się poruszamy, jest zasadniczo problemem przestrzennym. Dostrzegamy cel, oceniamy odległość, obieramy odpowiedni kierunek i podejmujemy kroki, aby się tam dostać. Widzimy schody i podnosimy stopę na tyle wysoko, by móc na nie wejść. Widzimy krawędzie chodnika i staramy się iść jego środkiem.

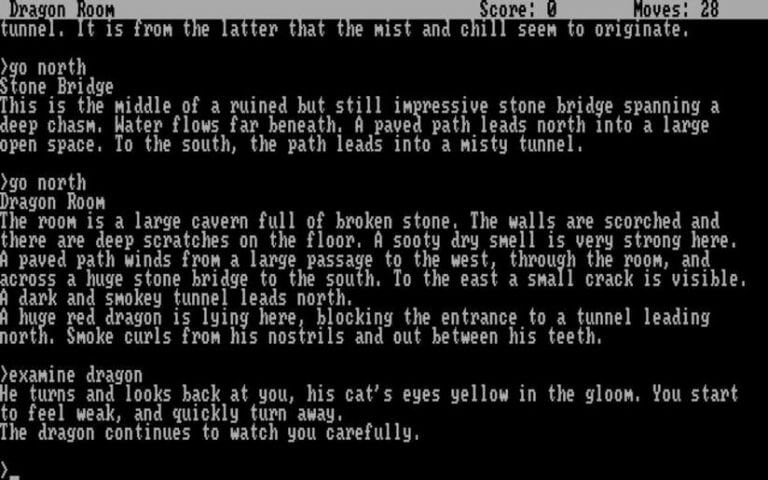

Ale jak pokazać relacje przestrzenne komuś, kto ich nie widzi? Jedna wskazówka pochodzi z klasycznych tekstowych gier komputerowych, które używają słów do scharakteryzowanie wirtualnego otoczenia. Gry te opisują, co znajduje się na północ, południe, wschód i zachód od objętej pozycji. Gracze używają tych informacji do budowania mapy mentalnej i poruszania się w labiryntach niewidzialnego świata.

Rys. 1. Tekstowy interfejs jednej z pierwszych przygodowych gier komputerowych Zork opisuje otoczenie gracza.

Gdyby tego rodzaju informacje opisowe były odczytywane na głos lub przekazywane za pomocą języka dotykowego (np. Baille’a) komuś z upośledzeniem wzroku, namalowałyby wokół niego podobny obraz przestrzeni.

Ale w prawdziwym życiu stawka jest znacznie wyższa. Istnieje niewielki margines błędu w przekazywaniu informacji osobie poruszającej się na przykład po ruchliwych ulicach miasta. Wszystkie informacje muszą być kompletne, dokładne, szczegółowe, dostępne i aktualne.

Repozytorium wiedzy przestrzennej

Osoby niewidome lub słabo widzące mogą być zainteresowane wszystkimi rodzajami informacji o otaczającym je świecie. Mogą po prostu chcieć wiedzieć, jak dostać się z punktu A do punktu B. Albo poznać rozkład jazdy autobusu. Mogą potrzebować informacji historycznych na temat budynku, przed którym się znajdują lub godzin jego otwarcia. Te informacje mają coś wspólnego: odnoszą się do konkretnych lokalizacji, połączeń między nimi lub szczegółów dotyczących tych lokalizacji.

Ogromne ilości informacji o lokalizacji mogą być zbierane w systemie informacji geograficznej (GIS), specjalistycznym repozytorium przechowującym wszystkie dane, których mogą potrzebować osoby z dysfunkcją wzroku. Na przykład, w systemie GIS dla miasta można znaleźć oznaczone punkty zainteresowania, takie jak przystanki autobusowe. Można również znaleźć informacje o tym, kiedy autobus zatrzyma się na każdym z przystanków lub dowiedzieć się, jakie interesujące miejsca znajdują się w odległości spaceru od przystanku. GIS może zawierać różne typy danych, takie jak współrzędne albo liczby (np. odległość do miejsca docelowego) lub tekst opisowy (jak w przypadku gry komputerowej). A teraz, gdy coraz więcej obiektów jest podłączonych do Internetu rzeczy, GIS może również pomieścić informacje przestrzenne o tych obiektach. I to w czasie rzeczywistym.

Rys. 2. Miasto Stralsund w Niemczech stworzyło ten model 3D z opisami w alfabecie Braille’a, służący jako statyczne urządzenie nawigacyjne dla osób niedowidzących.

Dzięki usprawnieniom w GPS, GIS może w czasie rzeczywistym zapewnić dokładność potrzebną do nawigacji w terenie. Może również współpracować ze sztuczną inteligencją (AI) i aplikacjami do uczenia maszynowego w celu wykonywania zadań takich jak wykrywanie różnych obiektów.

Pojawia się także możliwość użycia przez osoby niedowidzące receptora wzrokowego, takiego jak obiektyw aparatu fotograficznego. U osób widzących mózg łączy obrazy z obu oczu, aby umożliwić postrzeganie głębi i widzenie trójwymiarowe. Dwa obiektywy aparatu, umieszczone w niewielkiej odległości od siebie mogą jednocześnie wykonywać serie zdjęć, naśladując wzrok. Analiza różnicy między takimi dwoma obrazami może pomóc w obliczeniu rzeczywistej odległości do celu. Algorytmy uczenia maszynowego mogą zidentyfikować obiekt w czasie rzeczywistym, a następnie przekazać wynik z powrotem. System GIS może przekazać osobie niedowidzącej informacje o lokalizacji obiektu.

W ten sposób technologia zamienia lokalizację w mobilne okno na świat i informacje o nim.

Interfejsy: Oddzielenie sygnału od szumów

Aby cała ta technologia działała naprawdę na rzecz osoby niedowidzącej, należy odpowiedzieć na dwa ważne pytania: jakie informacje są najbardziej użyteczne i jaki jest najlepszy sposób ich przekazania?

Podczas nawigowania bez widoczności, wszystkie dostępne informacje nie są konieczne, a z pewnością nie są potrzebne wszystkie na raz. Przyjęcie wszystkich możliwych danych byłoby przytłaczające. Dostarczanie informacji musi być funkcjonalne.

Rys. 3. Specjalne urządzenie Braille’a zainstalowane przy klawiaturze komputera pomaga osobom niedowidzącym odczytać słowa wyświetlane na ekranie.

System informacji geograficznej pomaga w tym zakresie, pozwalając na samodzielny dostęp do wszelkich informacji, ale nie pokazując ich wszystkich jednocześnie. Deweloperzy mogą budować aplikacje, które współpracują z GIS-em w celu zaspokojenia konkretnych potrzeb. Użytkownicy mogą „zbliżać się” do dokładnej lokalizacji oraz dowiadywać się, co jest wokół.

W miarę rozwoju technologii usprawniane są sposoby przekazywania informacji. Na przykład, interfejsy głosowo-tekstowe są już wbudowane w wiele telefonów i urządzeń mobilnych. Niektóre organizacje stworzyły już aplikacje nawigacyjne dla osób z dysfunkcją wzroku. Dostępne interfejsy internetowe pozwalają osobom posiadającym czytniki ekranowe na nawigację i zwiedzanie obiektów w trybie online.

Dla osób niewidomych często ważnym elementem informacji jest dźwięk. Osoby te mogą już być dostrojone do otaczającego je krajobrazu dźwiękowego i wykorzystywać to sprzężenie zwrotne do poruszania się i doświadczania swojego otoczenia. Dlatego też instrukcje nawigacyjne lub opisy dostarczane w sposób dźwiękowy mogą zakłócać zbieranie informacji sensorycznych. W odpowiedzi na te obawy deweloperzy badają inne sposoby przekazywania informacji za pomocą technologii haptycznej, która wykorzystuje zmieniające się siłę, wibrację lub ruch. Na przykład, jedna wibracja może sygnalizować skręcenie w lewo, a dwie w prawo. Mapy haptyczne dostarczają dotykowych reprezentacji obszarów lub obiektów. Ludzie mogą dotykać i przeglądać te mapy z wyprzedzeniem, co pomaga w zapamiętaniu trasy, lub mogą korzystać z nich w trakcie przemieszczania się.

Patrząc w przyszłość

Deweloperzy na całym świecie wykorzystują już GIS do przekazywania informacji wizualnych na różne sposoby.

Nauczyciele w jednym z austriackich miast spędzili trzy lata na zbieraniu danych, aby pomóc osobom z wadami wzroku poruszać się po jego ulicach. Zespół zebrał szczegóły dotyczące chodników, ogrodzeń, skrzynek pocztowych i latarni. Połączono te informacje w system informacji geograficznej i opracowano aplikację, która dostarczyła je potrzebującym.

Rys. 4. Naukowcy zajmujący się technologią haptyczną pracują nad urządzeniami dotykowymi, które sygnalizują obszary, obiekty lub kierunki.

Dla osób z wadami wzroku równie ekscytujące są postępy i próby w mapowaniu wnętrz. Pewnego dnia powinno ono pomóc im nie tylko w dotarciu do celu, ale także w uzyskaniu pewności siebie podczas nawigacji we wnętrzach.

Potencjał działań humanitarnych w zakresie pomocy osobom niewidomym i niedowidzącym wzrośnie tylko wtedy, gdy będziemy dodawać coraz więcej pomocnych zestawów danych do repozytoriów takich jak GIS. Możemy spoglądać w przyszłość, w której osoby z wadami wzroku i niewidome będą mogły doświadczyć większego bezpieczeństwa, niezależności i lepszej jakości życia.